Reconstructing movie from human brain activity using deep generative diffusion model

氏名:Yu Takagi

所属:Osaka University

概要:ヒトの活動の多くは視覚的な体験を伴い、その情報は幅広い脳領域で処理されている。ヒト脳内の視覚情報処理を非侵襲的に探るために、これまでの認知神経科学研究では主に機能的核磁気共鳴画像法(fMRI)を用いてきた。具体的には、被験者がfMRI内で画像を観ている際に、機器から得られた信号値を解析することで、脳のどこにどのような視覚情報が表現されているかを明らかにしてきた。一方で、fMRIを用いた先行研究では静止画を視聴中の脳活動解析が主に行われており、より自然な動画像や音声を視聴中の脳活動を用いた解析は行われてこなかった。

本研究では、次の3つに取り組み、それぞれの結果は以下の通りである。

1.深層拡散生成モデルを用いた脳活動からの動画像再構成に取り組んだものの、fMRI脳活動からの動的画像再構成は時間解像度やノイズの観点から難しく、静的な画像に比して大幅に精度が低い再構成となることがわかった。

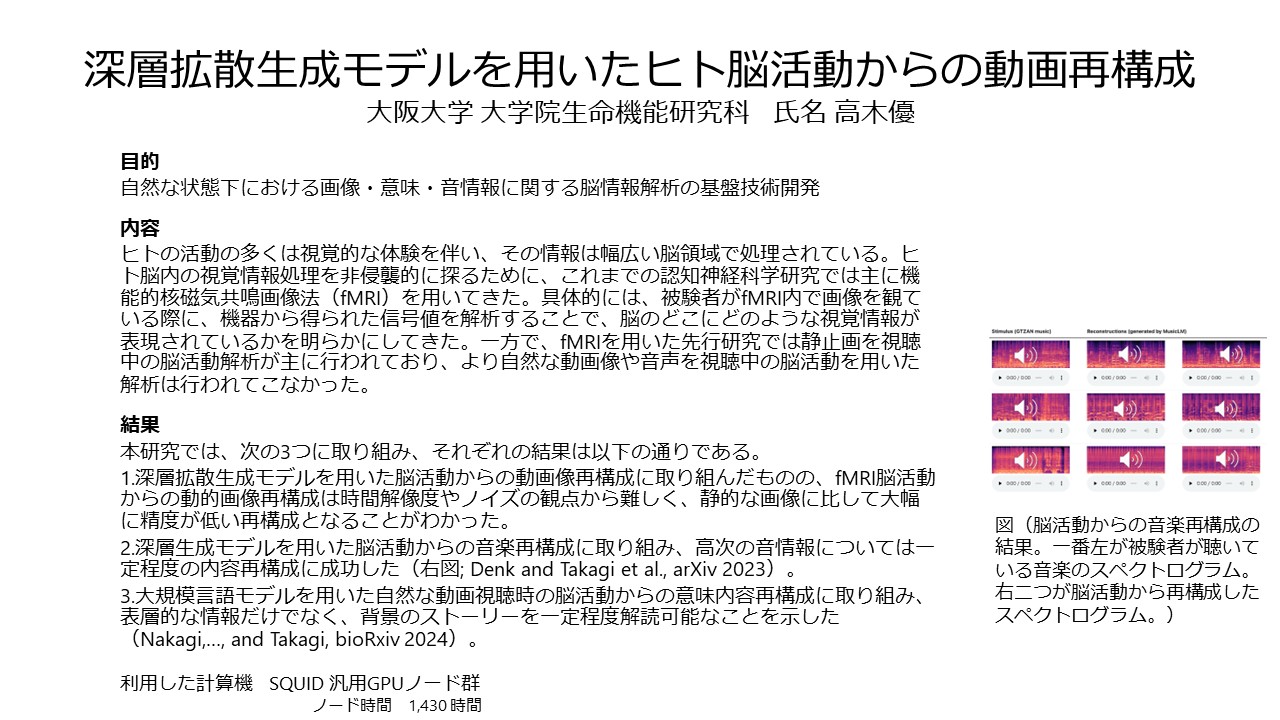

2.深層生成モデルを用いた脳活動からの音楽再構成に取り組み、高次の音情報については一定程度の内容再構成に成功した(右図; Denk and Takagi et al., arXiv 2023)。

3.大規模言語モデルを用いた自然な動画視聴時の脳活動からの意味内容再構成に取り組み、表層的な情報だけでなく、背景のストーリーを一定程度解読可能なことを示した(Nakagi,…, and Takagi, bioRxiv 2024)。

論文掲載,発表実績:

(学術雑誌掲載論文)

- Yuko Nakagi, Takua Matsuyama, Naoko Koide-Majima, Hiroto Yamaguchi, Rieko Kubo, Shinji Nishimoto, Yu Takagi, The Brain Tells a Story: Unveiling Distinct Representations of Semantic Content in Speech, Objects, and Stories in the Human Brain with Large Language Models, bioRxiv, 2024

- Timo I. Denk, Yu Takagi, Takuya Matsuyama, Andrea Agostinelli, Tomoya Nakai, Christian Frank, Shinji Nishimoto, Brain2Music: Reconstructing Music from Human Brain Activity, arXiv, 2023

Posted : 2024年03月31日